Poiesis, praxis, et les tâches qui changent de camp

Ce que 2500 ans de philosophie nous apprennent sur ce qui va survivre à l’IA

Mardi matin. Un manager reçoit un email de la direction : son équipe de 6 personnes passe à 3. Pas de plan social, pas de communiqué de presse. Les 3 autres partiront progressivement — on ne les remplacera juste pas. La raison officielle : “optimisation des process avec les nouveaux outils.”

Il y a deux ans, ce scénario semblait être le modèle dominant : une réduction silencieuse, par attrition, sans friction visible. L’IA grignotait des tâches à la marge. Les entreprises s’adaptaient discrètement.

Ce modèle est dépassé.

Depuis 2025, les grandes entreprises tech — celles qui ont accès aux modèles les plus puissants en premier — ne font plus semblant. Les chiffres sont publics, signés, assumés :

- Klarna a réduit ses effectifs de 40% en deux ans. Leur IA fait aujourd’hui le travail de 700 personnes, et le CEO l’a dit lui-même à CNBC en 2025, avec la désinvolture de quelqu’un qui annonce un bon trimestre.

- IBM : 8 000 postes RH éliminés par l’IA.

- Microsoft : 15 000 postes supprimés en deux vagues entre mai et juillet 2025. Satya Nadella a déclaré que l’IA écrit désormais 20 à 30% du code de l’entreprise, et que “la croissance d’effectifs que nous ferons sera avec beaucoup plus de levier qu’avant l’IA.”

- Amazon : Andy Jassy a publié en juin 2025 un mémo interne annonçant explicitement que l’IA “réduira les effectifs corporate dans les prochaines années.” Suivi de 14 000 puis 16 000 postes supprimés en octobre 2025 et janvier 2026.

- Oracle : entre 20 000 et 30 000 postes en cours de suppression en ce moment même — 12 à 18% des effectifs. Larry Ellison a déclaré que l’IA permet de “construire plus de logiciels en moins de temps avec moins de personnes.” En parallèle, Oracle investit 50 milliards de dollars en data centers IA cette année.

- Duolingo a annoncé en avril 2025 qu’il allait “progressivement arrêter d’utiliser des contractors pour les tâches que l’IA peut gérer.” Le CEO von Ahn a publié le mémo publiquement.

- Chegg, l’entreprise d’aide aux devoirs, a supprimé 45% de ses effectifs en octobre 2025 — non pas parce qu’elle a automatisé ses processus, mais parce que ses clients ont arrêté de payer : ils utilisent ChatGPT à la place. Ce n’est plus l’automatisation interne. C’est la destruction de la demande.

- UPS : 48 000 postes supprimés en novembre 2025. Pas de la tech — de la logistique physique. “L’IA permet de déplacer plus de volume avec moins de travailleurs.”

La tech est toujours en avance sur le reste. Ce qui se passe chez Microsoft et Oracle aujourd’hui arrive dans les PME dans deux ans. Ce n’est pas une prédiction — c’est le schéma historique de toutes les vagues technologiques précédentes, et rien n’indique que celle-ci sera différente.

Et en janvier 2026, Dario Amodei, le CEO d’Anthropic — la même entreprise qui construit Claude — a publiquement averti que l’IA allait causer une disruption “unusually painful” sur le marché du travail, avec 50% des postes d’entrée white-collar à risque dans les un à cinq ans. Le WEF chiffre ça à 41% des employeurs mondiaux qui prévoient de réduire leurs effectifs d’ici 2030, et Gartner prédit que 40% des applications d’entreprise intégreront des agents IA autonomes d’ici fin 2026 — contre moins de 5% en 2025.

Le modèle classique était juste — et il est en train de devenir faux

Pendant dix ans, le discours rassurant sur l’IA et l’emploi reposait sur une étude fondatrice : Frey & Osborne (Oxford, 2013) estimaient que 47% des emplois américains étaient à risque d’automatisation. Ce chiffre a tourné partout, souvent pour faire peur, parfois pour relativiser.

Ce qu’on citait moins : quand l’OCDE a refait l’analyse en 2016, non plus par métier mais tâche par tâche sur 21 pays, le chiffre est tombé à 9%. L’écart entre 47% et 9% n’est pas une contradiction — c’est une démonstration. Ce qui s’automatise, c’est la partie routinière de chaque poste. Pas le poste entier. Un comptable ne disparaît pas : sa saisie de données disparaît. Son interprétation d’une anomalie devant un client en crise, non.

Ce modèle avait une logique solide, fondée sur une hypothèse implicite : l’IA automatise des tâches isolées, une à la fois, dans un flux supervisé par un humain. Et cette hypothèse était juste — jusqu’à ce qu’elle ne le soit plus.

Les agents autonomes de 2025-2026 ne raisonnent plus à l’échelle de la tâche, ils raisonnent à l’échelle du workflow. Claude Code peut travailler pendant cinq heures sans interruption sur un projet entier — lire le codebase, planifier, écrire, tester, corriger, ouvrir une pull request. OpenAI Operator réserve des vols, gère des réclamations, remplit des formulaires de bout en bout. Salesforce Agentforce a supprimé 4 000 postes support en les remplaçant par des agents qui traitent des demandes clients de A à Z.

L'IA ne remplace plus la tâche. Elle remplace le processus.

La conséquence de second ordre est importante : même les professions que le modèle classique considérait comme “protégées” ont des workflows entiers qui deviennent automatisables. Le radiologue qui lit 200 images par jour est une cible. Le radiologue qui annonce un diagnostic à une famille et décide d’un protocole de traitement en incertitude, non. La distinction n’est plus entre professions — elle est à l’intérieur de chaque profession.

Aristote avait déjà la réponse

Il y a 2 500 ans, Aristote distinguait deux modes fondamentalement différents d’activité humaine.

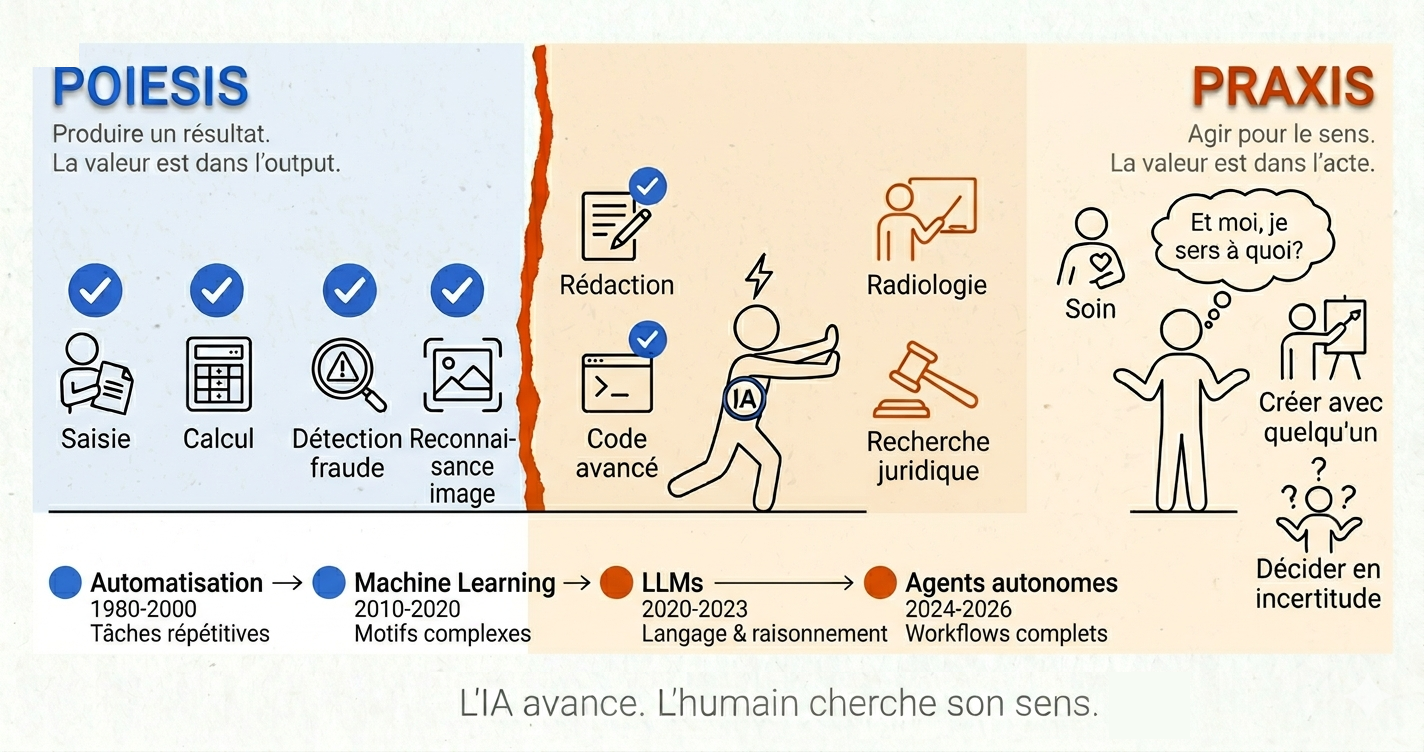

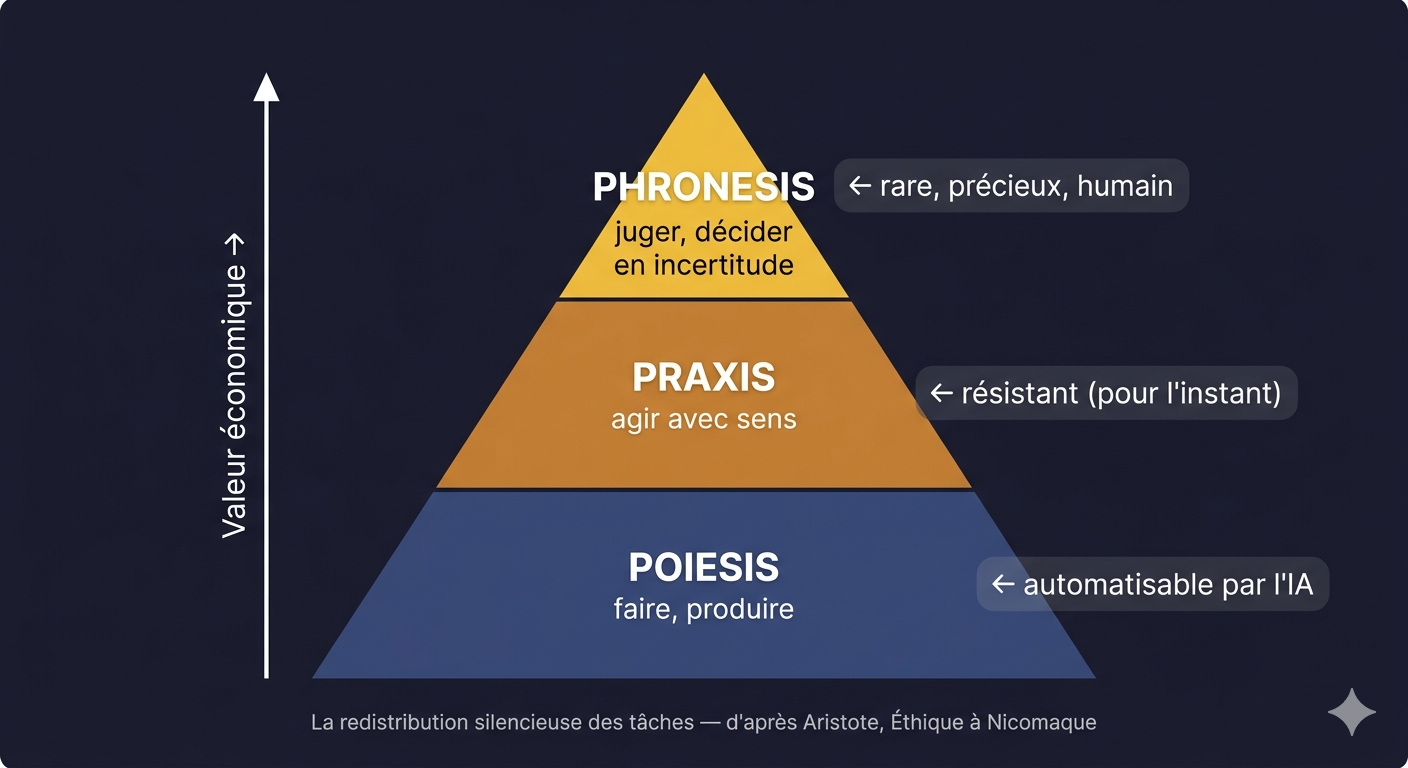

La poiesis — du grec poiein, faire, produire — désigne toute action orientée vers un objet extérieur. Un rapport, une analyse, un code, un repas. La valeur est dans le résultat, pas dans l’acte lui-même. Une fois le résultat obtenu, l’activité n’a plus de raison d’être. La poiesis est un moyen vers une fin.

La praxis — du grec prassein, agir — désigne l’action dont la valeur réside dans l’action elle-même. Soigner, délibérer, éduquer, créer avec quelqu’un. L’activité est sa propre fin. On ne soigne pas pour avoir soigné. On soigne parce que l’acte de soin est lui-même ce qui compte.

“L’action a sa fin en elle-même, tandis que la production a sa fin dans un objet séparé de l’activité.” — Aristote, Éthique à Nicomaque

L’IA automatise la poiesis. Elle y excelle, elle y est souvent supérieure. Ce qu’elle ne peut pas automatiser, c’est la praxis — parce que la praxis n’est pas définie par son output. Elle est définie par qui agit et comment cette action transforme ce qui se passe entre les personnes impliquées.

Un agent IA peut rédiger un compte-rendu médical plus précis qu’un médecin. Il ne peut pas être le médecin qui regarde le patient dans les yeux et lui annonce quelque chose d’irréversible. Ce n’est pas qu’il manque de compétence technique — c’est que la valeur de cet acte est inséparable de la présence humaine qui l’accomplit.

Viktor Frankl — neuropsychiatre, survivant des camps de concentration, auteur de Man’s Search for Meaning (1946) — a formulé cela dans des conditions extrêmes. Quand tout a été retiré à un prisonnier — ses biens, son identité, sa liberté physique — ce qui restait était la capacité à choisir son attitude face à ce qui lui arrivait. Cette liberté intérieure n’est pas une consolation philosophique abstraite. C’est la définition opérationnelle de la praxis : la valeur d’un acte humain qui ne peut pas être délégué parce qu’il est constitutif de l’identité de celui qui l’accomplit.

Hannah Arendt, dans The Human Condition (1958), formulait un avertissement que personne n’a pris au sérieux à l’époque : une société libérée du travail routinier par l’automatisation pourrait se retrouver avec une liberté vide — des personnes dont toute l’identité s’était construite autour de la production, sans les ressources culturelles et existentielles pour habiter la liberté que l’automatisation leur offre. Ce n’est pas un paradoxe rhétorique. C’est une prédiction qui commence, très concrètement, à se matérialiser.

En 2026, je travaille dans une grande entreprise en parallèle de mes projets personnels. La position est particulière — pas inconfortable, mais lucide. J’ai fait le choix délibéré d’être en première ligne : builder des systèmes, adopter l’IA, devenir la référence sur le sujet dans mon environnement, précisément pour ne pas me retrouver du côté subi. Avant même les agents autonomes, quand je suis arrivé dans mon poste, j’avais automatisé des processus qui prenaient deux semaines et les avais ramenés à deux jours. Ce faisant, j’ai posé la question moi-même, sans vraiment la formuler à voix haute : est-ce que ça justifie encore un poste à temps plein sur ces tâches ?

Je vois des gens qui ratent le train — qui évitent le sujet, qui espèrent que ça passe. Je comprends l’instinct, mais je sais ce que ça donne. La distinction poiesis/praxis n’est donc pas pour moi une catégorie abstraite — c’est le filtre à travers lequel je décide, très pratiquement, où investir mon énergie.

Quatre ruptures qui ont changé le camp des tâches

Ce glissement n’est pas nouveau. Il se produit par vagues, chaque fois qu’une rupture technologique rend codifiable ce qui ne l’était pas.

1980-2000 — Automatisation et scripts

Les premières tâches à basculer sont les plus mécaniques : saisie de données, calcul, tri, classement, traitement par lots. Dès lors qu’une tâche est exprimable en règles déterministes, elle bascule.

2010-2020 — Machine Learning

Le machine learning a franchi un seuil différent : les tâches qui ne sont pas exprimables en règles explicites, mais qui ont des patterns détectables dans les données. Détection de fraude, reconnaissance d’images, recommandations, diagnostic sur données structurées. Le ML a appris à extraire ces patterns sans qu’on sache les formuler explicitement.

2020-2023 — LLMs

Les grands modèles de langage ont fait basculer les tâches liées au langage et au raisonnement discursif : rédaction, synthèse, traduction, analyse de texte, réponse à des questions complexes, génération de code. Le support client de niveau 1, la recherche documentaire, la rédaction de rapports standards : basculés.

2024-2026 — Agents autonomes

C’est la rupture en cours. Les agents autonomes ne font pas une tâche à la fois dans un flux supervisé. Ils exécutent des workflows complets — séquences d’actions, prise de décisions intermédiaires, adaptation en cours d’exécution. Ce que cette rupture rend codifiable : tout ce qui était protégé non pas par la complexité d’une tâche isolée, mais par la complexité de l’enchaînement — la continuité de jugement que seul un humain pouvait assurer. Les agents ont cette continuité.

Ce qui ne bascule pas encore : les tâches dont la valeur tient à l’imprévisibilité radicale de la situation et à la présence physique et relationnelle de l’humain.

La question à se poser pour chaque tâche dans son propre poste n’est donc pas “est-ce complexe ?” mais “est-ce codifiable par l’une de ces quatre méthodes ?” Si oui — elle finira par basculer.

Les tâches qui changent de camp

La distinction poiesis/praxis tient. Ce qui change, c’est le classement des tâches.

Ce n’est pas une frontière qui avance. C’est un répertoire qui se réécrit. Une tâche peut être dans la praxis pendant des décennies — parce qu’elle requiert du jugement, de la présence, une forme d’intelligence contextuelle — puis basculer dans la poiesis le jour où une IA apprend à la faire aussi bien, ou mieux. Le mouvement n’est pas spatial. Il est catégoriel.

C’était vrai avant l’IA. L’industrialisation a fait exactement ça avec le travail artisanal : tisser, forger, assembler étaient des praxis au sens où la maîtrise du geste définissait l’artisan. La machine a transformé ces actes en poiesis — les séparant de l’identité de celui qui les accomplissait. L’IA fait la même chose, mais dans des domaines qu’on croyait immunisés.

La recherche juridique était de la praxis pour le juriste junior — elle mobilisait son jugement, sa culture du droit, sa capacité à naviguer l’ambiguïté. Harvey AI la fait aujourd’hui mieux et plus vite, non pas parce que le droit est devenu simple, mais parce que cette partie du droit est désormais codifiable : elle a glissé dans la vague LLMs. Le coding d’architecture complexe, longtemps la chasse gardée du développeur senior, suit le même chemin avec les agents autonomes : Claude Code travaille pendant cinq heures sur un projet entier sans supervision. La radiologie diagnostique — acte médical chargé de responsabilité, de formation, d’expérience accumulée — voit les modèles de vision dépasser les radiologues humains sur la détection de certains cancers depuis la vague Machine Learning. Elle glisse aussi.

Ce que ces exemples ont en commun : ce ne sont pas des tâches simples. Ce sont des tâches codifiables — c’est-à-dire qu’on peut en extraire les règles, les patterns, les critères de réussite, et les enseigner à un modèle. C’est le seuil de codifiabilité : dès lors qu’une tâche le franchit, elle finit par glisser. La question n’est pas si. C’est quand.

La réduction silencieuse — ce qu’on ne dit pas

Personne n’a été licencié. Les postes ont juste cessé d’exister.

Les licenciements d’Oracle, d’Amazon ou de Microsoft font les titres. Ils sont spectaculaires, chiffrés, assumés par des dirigeants qui signent des mémos publics. Mais ils ne représentent qu’une partie du phénomène — la partie visible.

Il y a un autre mécanisme, du même acabit mais sans le bruit, qui touche des millions d’organisations qui ne feront jamais la une de TechCrunch. Pas des suppressions annoncées. De l’attrition dirigée : les entreprises documentent les processus, construisent des compagnons IA, “augmentent” les équipes — et puis ne rembauchent plus quand quelqu’un part. Une personne fait le travail de trois. L’effectif diminue sans plan social, sans alerte syndicale, sans couverture médiatique.

Le mécanisme est si discret que les protections sociales ne le voient pas — elles ont été conçues pour les licenciements, pas pour le non-remplacement.

La conséquence de second ordre est inquiétante : les “constructeurs de systèmes” — ceux qui documentent les processus, qui construisent les compagnons IA, qui sont félicités pour ça — participent involontairement à créer les conditions du remplacement de leurs collègues. Ce n’est pas de la malveillance. C’est de la rationalité locale.

Je le vis de l’intérieur. J’ai automatisé une partie de mes tâches en construisant des outils IA pour mon propre usage — un système qui capture, classe et met à jour mes idées de travail en temps réel. On valorise ce genre d’initiative dans la plupart des grandes entreprises. Ce que personne ne dit à voix haute : c’est exactement pour ça qu’on ne rembauche pas un poste quand quelqu’un part.

MIT Sloan Management Review (2023) a documenté ce mécanisme sous le nom d‘“attrition dirigée” : les entreprises qui adoptent l’IA ne licencient pas — elles ne remplacent pas les départs. McKinsey (2023) confirme : les équipes “augmentées” maintiennent leurs effectifs stables à court terme, puis compriment à mesure que les départs ne sont pas compensés.

La crise d’identité qui arrive

Il y a un angle qu’on n’a pas encore nommé et qui est peut-être le plus important à long terme.

Dans les sociétés industrielles et post-industrielles, l’identité personnelle est massivement construite autour du travail. Que fais-tu dans la vie ? est la question centrale de toute rencontre. Un comptable ne fait pas que compter — il est comptable.

Quand l’IA prend ces tâches — non pas le métier entier, mais la partie qui structurait le quotidien et créait le sentiment de compétence — quelque chose se rompt. Pas le poste. L’identité qui y était accrochée.

Des chercheurs du MIT ont documenté ce phénomène sous le nom de AI identity threat (2022) : les travailleurs dont l’IA absorbe les tâches caractéristiques de leur profession vivent une érosion de leur identité professionnelle bien avant que leur poste soit menacé. Le comptable dont l’IA réconcilie les comptes automatiquement n’est pas licencié. Mais il perd progressivement ce qui lui donnait le sentiment d’être bon dans son travail.

Une étude de 2025 publiée dans Nature Scientific Reports (N=269) a montré quelque chose de frappant : l’utilisation passive de l’IA — copier-coller du contenu généré sans s’engager dans le travail — réduit significativement le sens perçu dans le travail, la confiance en soi et le sentiment de propriété sur ce qu’on produit. Ce n’est pas l’IA qui détruit le sens. C’est la délégation passive.

Hannah Arendt avait anticipé cette crise : une société qui a résolu le problème du travail mais n’a pas résolu le problème du sens du travail se retrouve avec des individus libérés d’une contrainte sans avoir les ressources pour habiter cette liberté.

La prochaine décennie va produire des millions de personnes dans cette situation : leur poste existe encore, leurs tâches routinières ont disparu ou sont en train de disparaître, et personne ne leur a appris à construire une identité sur autre chose que ce qu’elles produisent.

Ce qui résiste : le filtre pratique

Face à ça, la question n’est pas “est-ce que mon métier va survivre ?” Elle est plus précise.

Pour chaque tâche récurrente dans ton poste, pose-toi cette question : si une IA faisait exactement ça à ma place, est-ce que le résultat serait identique pour celui qui le reçoit ?

J’ai construit un outil pour rendre cette analyse systématique : l’AI-Proof Job Scanner analyse un poste tâche par tâche et calcule un score de résilience face à l’automatisation. La méthodologie vient directement de ce cadre.

Si la réponse est oui, c’est de la poiesis — automatise-la, délègue-la, et cesse surtout de la défendre comme valeur ajoutée humaine, parce qu’elle n’en est plus une.

Si la réponse est non, c’est de la praxis — développe-la, approfondis-la, mets-la en avant, c’est là que ta valeur devient structurellement difficile à remplacer.

| Activité | Résistance | Époque du glissement | Raison |

|---|---|---|---|

| Saisie de données, comptabilité routinière | Quasi nulle | Scripts (1980-2000) | 100% codifiable dès le départ |

| Support client tier-1 | Faible | LLMs (2020-2023) | Scripts + NLP |

| Radiologie (lecture d’images) | Faible-moyenne | ML (2010-2020) | L’IA dépasse la précision humaine |

| Médecine : relation thérapeutique | Élevée | — | Présence, incertitude partagée |

| Thérapie psychologique | Très élevée | — | Intersubjectivité, confiance |

| Enseignement (contenu factuel) | Faible-moyenne | LLMs + Agents | L’IA s’adapte mieux à l’individu |

| Enseignement (mentoring, identité) | Très élevée | — | Présence, modèle, ajustement |

| Avocat (recherche juridique) | Faible | LLMs + Agents | Harvey AI domine déjà |

| Avocat (plaidoirie, négociation) | Élevée | — | Jugement, persuasion, relation |

| Travail de deuil, soins palliatifs | Extrêmement élevée | — | Présence irremplaçable |

| Créativité “moyenne” | Moyenne | LLMs (2020-2023) | L’IA dépasse l’humain moyen — pour l’instant |

| Créativité d’exception | Élevée (incertaine) | À suivre | Top 10% humains encore loin devant, mais l’écart se réduit |

Avant de répondre à ces chiffres, il faut éviter l’erreur symétrique : ni nier ce qui se passe, ni conclure à l’apocalypse de l’emploi. L’emploi fonctionne comme un élastique — Twitter/X a coupé 80% de ses effectifs sous Musk, puis a recommencé à embaucher sur d’autres profils. Ce qui disparaît, c’est la valeur de certaines compétences dans certains contextes, pas la demande de travail humain en général.

L’économie nous donne un cadre pour comprendre pourquoi. En finance, la notion d’élasticité-prix mesure la résistance d’un bien à la substitution : un bien inélastique — le pétrole, l’insuline — voit sa demande rester stable même quand le prix monte, parce qu’il n’existe pas d’équivalent fonctionnel. Un bien élastique s’effondre dès qu’un concurrent moins cher apparaît. Les compétences obéissent aux mêmes lois : une compétence de praxis est inélastique par définition — sa valeur tient précisément à ce qu’aucun agent ne peut la reproduire à l’identique. Une compétence de poiesis codifiable est élastique — dès qu’un modèle fait la même chose moins cher, la demande pour la version humaine disparaît.

Les compétences obéissent aux mêmes lois que les prix : ce qui est substituable finit par être substitué.

La réponse n’est pas de résister. C’est de monter d’un cran — passer de faire à diriger, de produire à décider pourquoi on produit, d’exécuter à valider avec jugement.

Mais il faut nommer une limite que les chiffres n’anticipent pas bien : “monter d’un cran” suppose qu’on a déjà grimpé les premières marches. Les postes d’entrée ne servaient pas seulement à exécuter des tâches — ils servaient à former. Un juriste junior qui fait de la recherche juridique pendant deux ans n’apprend pas juste à chercher : il apprend à lire le droit, à naviguer l’ambiguïté, à développer le jugement qui fera de lui un senior. Si Harvey AI fait cette recherche à sa place dès le premier jour, qu’est-ce qu’il apprend exactement ?

Des études récentes confirment l’intuition : les étudiants qui apprennent sans IA retiennent significativement mieux que ceux qui s’appuient dessus passivement. La boucle itérative erreur-correction-compréhension, c’est le mécanisme de formation de la praxis. L’IA peut l’accélérer si on l’utilise bien — mais si elle exécute à la place, elle court-circuite précisément ce qu’elle est censée accélérer. Le risque à moyen terme : une économie avec des postes de seniors et plus personne formé pour les occuper.

Les postes les plus exposés sont aussi les postes d’entrée — ceux qui permettaient à des gens sans bagage universitaire de construire une expertise progressive. Si ces marches disparaissent, c’est une question de mobilité sociale autant que de reconversion individuelle.

Made by Human — et après ?

Quand les usines ont délocalisé dans les années 1980-2000, un label est apparu en réaction : Made in France, Made in Italy — la preuve d’origine comme argument marketing, la traçabilité humaine et géographique comme valeur ajoutée dans un monde d’optimisation. L’IA va probablement provoquer quelque chose d’analogue. Pour une partie de la population, savoir qu’un texte, une œuvre, un conseil a été produit par un humain deviendra un signal de valeur en soi — pas parce que le résultat est nécessairement meilleur, mais parce que la relation et l’engagement derrière sont différents.

Je suis moi-même dans une position ambiguë sur ce point : j’utilise l’IA massivement pour produire, et je l’assume complètement. Ce que je fais avec elle, je ne pourrais pas le faire sans elle — pas à cette cadence, pas à cette qualité. Mais je dirige, je décide, je valide, j’apporte le point de vue. Est-ce du Made by Human ? Probablement une troisième catégorie qui n’a pas encore de nom.

Du Made in France au Made by Human — on est passé du lieu de production à l'identité du producteur.

Ce glissement soulève une question que les deux premiers termes d’Aristote ne résolvent pas entièrement : qu’est-ce que c’est, exactement, diriger une IA ? Ni faire, ni agir — quelque chose de tiers. Aristote, là aussi, avait un mot.

La troisième économie — la phronesis

Il manque peut-être un troisième terme à Aristote.

Qu’est-ce que c’est, écrire un article en dirigeant une IA ? Ce n’est pas de la poiesis — je ne produis pas le texte mot à mot. Ce n’est pas de la praxis pure — l’exécution est déléguée. C’est quelque chose d’intermédiaire : l’intention reste humaine, le jugement reste humain, mais le geste est distribué entre l’humain et la machine.

Aristote avait un terme pour ça aussi : la phronesis — la sagesse pratique, la capacité à décider juste dans des situations complexes sans règle préétablie. Pas faire, pas agir — juger. Diriger sans exécuter. Concevoir sans produire soi-même. Naval Ravikant en a une version moderne dans ce qu’il appelle le Judgment : être payé pour ses décisions, pas pour son temps — parce que le bon jugement appliqué à du levier produit des résultats exponentiels. C’est exactement ce que l’IA rend possible à grande échelle : le levier existe, il attend le jugement.

La phronesis n’est pas un point de départ. Elle se construit sur des années de praxis accumulée — c’est pour ça que court-circuiter les postes d’entrée est risqué : on ne développe pas le jugement en sautant l’exécution, on le développe par l’exécution, jusqu’à ce qu’elle devienne inutile.

Pour entrer dans la praxis, il faut être passé par la poiesis. Pour entrer dans la phronesis, il faut avoir épuisé la praxis.

Chaque niveau suppose le précédent :

- La phronesis présuppose la praxis : on ne peut pas juger en incertitude sans d’abord savoir agir avec sens — le bon jugement s’exerce dans l’action, pas au-dessus d’elle.

- La praxis présuppose la poiesis : l’action humaine qui a du sens se déploie toujours dans un monde matériel qu’il faut d’abord construire.

Chez Aristote c’est explicite — la phronesis est la vertu qui gouverne la praxis, elle n’existe pas sans elle. Ce n’est pas une hiérarchie de valeur abstraite, c’est une hiérarchie de dépendance.

Ce qu’Aristote a vraiment défini avec ces trois termes, c’est une hiérarchie de ce que l’être humain peut confier à autre chose que lui-même. La poiesis est délégable — à un esclave, à un outil, à une machine. La praxis ne l’est pas : elle implique le caractère de celui qui agit. La phronesis encore moins : c’est la capacité à juger juste dans des situations où aucune règle ne suffit.

Aristote n'avait pas prévu Claude. Mais il avait déjà prévu ce qu'on lui déléguerait.

C’est peut-être ça, la troisième économie qui se dessine : pas celle de ceux qui font (poiesis, automatisable), pas celle de ceux qui agissent avec présence (praxis, irremplaçable en contexte humain) — mais celle de ceux qui jugent avec suffisamment de compétence et de contexte pour diriger ce que les agents exécutent.

Développer sa phronesis : une ébauche de méthode

La phronesis ne se décrète pas, elle se construit — et c’est peut-être l’enjeu pratique le plus important de la prochaine décennie pour quiconque veut rester pertinent. Quelques pistes, non exhaustives.

Cartographier ses tâches. Pour chaque activité récurrente, se demander honnêtement si elle relève de la poiesis (exécutable, délégable) ou de la praxis (irréductiblement humaine). Pas pour se rassurer — pour décider où investir son attention. L’AI-Proof Job Scanner est un outil que j’ai construit exactement pour ça : analyser un poste tâche par tâche et calculer un score de résilience.

Ne pas sauter les étapes. Utiliser l’IA pour accélérer l’apprentissage, pas pour le remplacer. La boucle erreur-correction-compréhension est le mécanisme de formation du jugement — déléguer l’exécution avant d’avoir maîtrisé ce qu’on délègue, c’est optimiser la vitesse au détriment de la compétence. On peut arriver vite quelque part sans savoir où on est.

Accumuler des décisions tracées. Le jugement se forme par l’expérience des décisions passées et de leurs conséquences. Tenir un log — pas des tâches, des décisions et de leurs résultats. C’est ce que Naval Ravikant appelle le Judgment Track Record : la réputation de bien décider se construit dans la durée, et elle ne se construit pas sans trace.

Il y a probablement une méthode plus complète à construire là-dessus — comment passer délibérément de la poiesis à la praxis, puis à la phronesis. C’est quelque chose que j’explore activement, et que j’envisage de formaliser. Si ce sujet t’intéresse, réponds à cette newsletter — c’est exactement le genre de signal qui m’indique où aller.

Sources : Frankl, V. (1946). Man’s Search for Meaning · Aristote, Éthique à Nicomaque (~350 av. J.-C.) · Arendt, H. (1958). The Human Condition · Frey & Osborne (2013). The Future of Employment, Oxford Martin School · Arntz, Gregory & Zierahn (2016). OCDE · Autor, D. (2019). Work of the Past, Work of the Future, NBER · Brynjolfsson, Li & Raymond (2023). Generative AI at Work, NBER · Acemoglu & Restrepo (2019). Automation and New Tasks · WEF Future of Jobs Report (2025) · Klarna / CNBC (2025) · Amodei, D. / CNBC (janvier 2026) · Gartner (2025-2026) · Scientific Reports (2025). Relying on AI at work reduces meaning · AI identity threat, Springer (2022) · MIT Sloan Management Review (2023) · McKinsey Global Institute (2023)